编辑推荐:

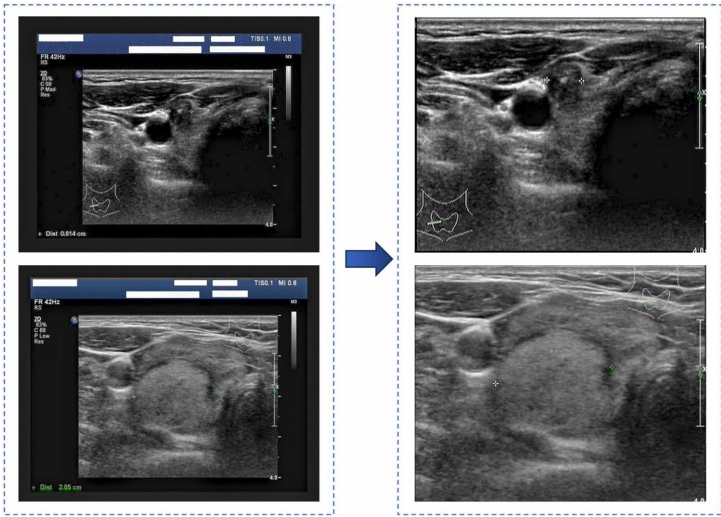

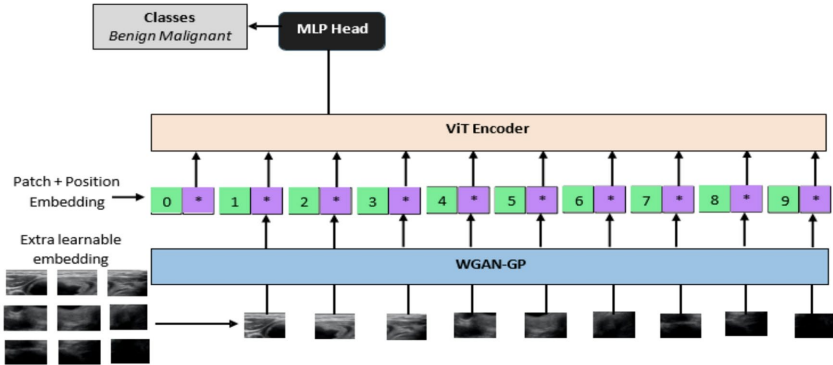

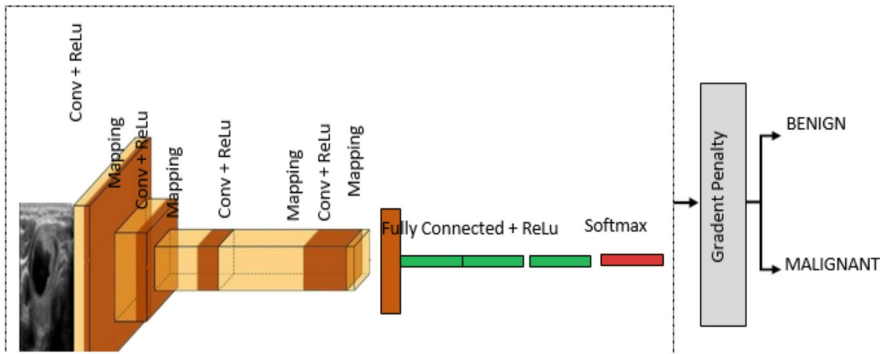

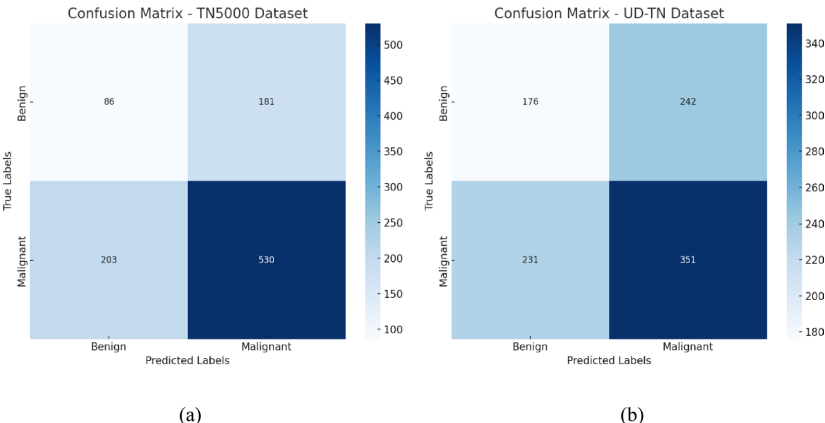

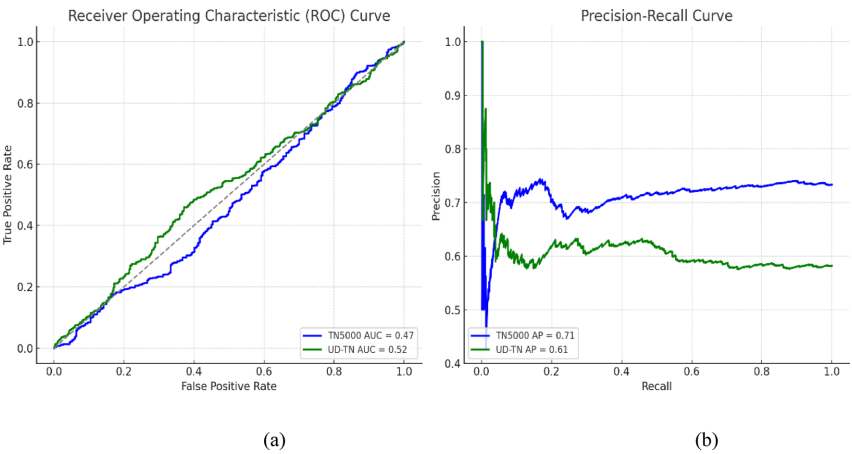

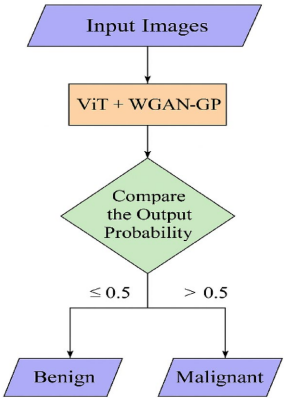

本研究针对甲状腺结节超声图像分类中CNN模型难以捕捉全局上下文信息及医学数据集类别不平衡的问题,提出了一种结合视觉Transformer(ViT)和带梯度惩罚的Wasserstein生成对抗网络(WGAN-GP)的混合模型。该模型利用ViT的自注意力机制提取局部和全局特征,同时通过WGAN-GP生成高质量合成图像以解决数据不平衡问题。在TN5000和UD-TN数据集上的实验表明,该模型准确率分别达到96.8%和97.1%,灵敏度达97.3%-97.5%,显著优于现有方法,为甲状腺结节的自动化诊断提供了可靠工具。

生物通 版权所有